![图片[1]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-56944a7f72c86710d703084b54efe02f.jpeg)

摘要

本文摘要

/ www.yxclass.net

![图片[2]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-fc87b5e5efcc6e83fed674b70841a85e.png)

01

Ollama PC本地化部署

/ www.yxclass.net

下载Ollama

Ollama 是开源大模型应用,能本地快速运行各类模型,支持多模型切换,操作简便,为用户提供高效本地化 AI 体验。

网址:https://ollama.com/download

![图片[3]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-3891d8ecac65b71d9df14eb0ddfd2514.png)

Linux系统需要执行下面命令:

curl -fsSL https://ollama.com/install.sh | sh

网盘下载Ollama

Githup有时需要魔法才能访问,而且国外网速超级慢,因此我为大家提供了便捷的下载方式。关注我公众号后,发送“ollama”就可以获取下载链接。

![图片[4]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-35ed1d0d038b798ae8c43dd5e69f514c.png)

安装Ollama

![图片[5]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-c846fdad5ac5fc97332611f3be617ed3.png)

双击下载好的安装文件,点击「Install」开始安装。目前的Ollama会默认安装到C盘,路径如下:

C:Users%username%AppDataLocalProgramsOllama

![图片[6]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-942b2ac89e1891a4614d2b916f734960.png)

配置Ollama的环境变量

Ollama 服务器默认只允许来自127.0.0.1的跨域请求,如果你计划在其它前端面板中调用 Ollama API,比如Chatbox和AnythingLLM,需要放开跨域限制。

放开跨域限制要配置下面两个环境变量:

OLLAMA_HOST:0.0.0.0

OLLAMA_ORIGINS:*

配置Ollama的环境变量前一定要退出Ollama,否则下边的环境配置无法生效!

右键图标,会出现退出的按钮「Quit Ollama」。

![图片[7]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-55f4e67d406742eb3fc61815331df8d7.png)

1、在电脑的搜索框输入“编辑系统环境变量”,然后点击搜索出的链接。

2、新建用户环境变量。

![图片[8]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-d67d5281df8a2784aa7094069396bda8.png)

![图片[9]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-3868cac8dc22b9babace5db07871c0bd.png)

环境变量新建保存成功后,再次进入看到下面两个变量就是环境配置好了。

![图片[10]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-98b16357435b22c2dc94ad72d2243f39.png)

关闭开机自启动

Ollama 默认会随 Windows 自动启动,可以在「文件资源管理器」的地址栏中访问以下路径,删除其中的Ollama.lnk快捷方式文件,阻止它自动启动。

复制下面的路径粘贴到文件搜索栏:

%APPDATA%MicrosoftWindowsStart MenuProgramsStartup

![图片[11]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-bbc813a07f57dc4fac4a524756622206.png)

启动Ollama

将上述更改的环境变量保存后,在「开始」菜单中找到 Ollama,点击图标就可以重新启动,在cmd窗口执行ollama命令。

![图片[12]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-a42101f56fa34d296f014359312c934c.png)

02

deepseek-r1模型

/ www.yxclass.net

模型查找

Ollama安装好后就可以去选择deepseek-r1模型了。

查找网址:

https://ollama.com/search

![图片[13]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-6d2edbe623f0e9acd571d2f5d7042351.png)

deepseek-r1各规模模型对本机PC的硬件要求:

![图片[14]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-3025f39c0be9c26bfda3f615f8fa2f93.jpeg)

选择模型

普通个人电脑选择1.5b的模型就可以了,我16核24G的笔记本一开始选择8b的模型回答很慢,后来改为1.5b的模型问答就快很多了。

在Ollama上选择对应的模型参数,然后复制安装命令到cmd窗口中。

ollama run deepseek-r1:1.5b

![图片[15]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-6ff50da54e44ed7ef9d899642a9fd19a.png)

运行命令

![图片[16]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-64033509c588dfd42a93cc434391e955.png)

Ollama启动deepseek

没有取消开机自启,只需打开cmd窗口,然后执行指令ollama run 。

例如:

ollama run deepseek-r1:1.5b

取消开机自启,电脑开机后需要进入到安装的ollama.exe目录,然后执行指令ollama run 。

例如:

ollama run deepseek-r1:8b

![图片[17]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-0a8b7e763423e0de2f45d6e0f0fbff2a.png)

03

Chatbox

/ www.yxclass.net

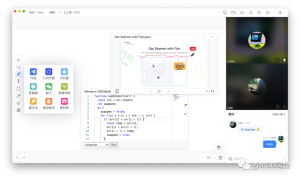

DeepSeek+Chatbox

本地cmd窗口命令行使用不太直观,可以安装Chatbox,通过UI页面与模型进行提问,提高可交互性。

Chatbox AI 是一款 AI 客户端应用和智能助手,支持众多先进的 AI 模型和 API,可在 Windows、MacOS、Android、iOS、Linux 和网页版上使用。

下载网址

https://chatboxai.app/zh/install?download

![图片[18]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-2682f55e00e61f780a80e643e12179b4.png)

本地使用Ollama部署完成后,就可以使用Chatbox进行调用。

根据官方文档给出的步骤进行配置

https://chatboxai.app/zh/help-center/connect-chatbox-remote-ollama-service-guide

安装Chatbox

![图片[19]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-b72193fff855144db5d0d14fd9a8e7d5.png)

安装成功后,打开APP,选择Use My Own API Key / Local Model。

然后打开的对话框根据提示选择对应的模型。

模型提供方选择【Ollama API】。

模型选择自己的安装的模型。

![图片[20]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-0b465fcf3febafde37f975672424b0de.png)

问答测试

![图片[21]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-1af451bdc6971d296336fa501872e6bb.png)

04

DeepSeek知识库搭建

/ www.yxclass.net

知识库应用场景

在日常的学习与工作中,你或许常常深陷这样的困境:手头堆积着如山的 PDF 文件,急需从中找出特定信息,于是习惯性地依赖 Ctrl+F 快捷键,在繁杂的文档海洋里反复摸索,花费大量时间,却依旧一无所获,挫败感扑面而来。

尤其是遇到那些格式怪异的文档时,常规的搜索功能完全失效,简直让人无从下手。其实,我们都渴望着一种更便捷、高效的解决方案。设想一下,倘若存在一款工具,只需将文档轻松 “投喂” 给 AI,随后便能如同与老友交谈一般,通过智能对话精准、迅速地获取关键内容,彻底告别繁琐的手动搜索,这该多美妙。而 AnythingLLM 正是这样一款契合需求的得力工具,有它助力,信息检索之路将畅行无阻。

AnythingLLM

AnythingLLM 由 mintplexlabs 推出,是一款开源全栈应用。它能将多种格式的文档转化为大语言模型的聊天背景知识,支持多用户管理,可自选模型与向量数据库,上手简单。其具备自定义 AI 代理、多模态等特性,创建工作区可有序管理文档,适用于学术、办公、客服等场景,有效助力信息获取,提升效率。

下载网址:

https://anythingllm.com/desktop

点击.exe文件即可安装,如果发现以管理员身份安装没有反应,就选中安装包,右键选择“属性”查看安装文件是否已经被锁定。

![图片[22]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-b58a33b1a2079b888a1e650048fce813.png)

配置模型的连接信息

安装成功后,打开APP就根据提示一直下一步就行了,安装好开始配置 这里选Ollama 地址按它默认的填就行。

打开后可以点击【open setting】查看配置内容,自己的AI模型是使用Ollama安装的,那么LLM的首选项就是Ollama。

![图片[23]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-c62a9861ec79ded03fb0cfca14314aab.jpeg)

![图片[24]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-bad6b032510a0ae8c00f4edb5de2eebd.png)

![图片[25]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-c3051aebf3a7abbc3317ec0641de081c.png)

![图片[26]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-a100f42e9d78a87b1e34c409953e39f3.png)

新建工作区

页面打开后点击新建工作区,聊天设置的工作区LLM提供者选择Ollama。

![图片[27]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-7eaf0887153e2b9825884249e81c6a46.png)

当未向 DeepSeek 上传个人文档以丰富其知识储备时,向它提出一些基于特定个人资料、小众领域专业文档或私有项目细节等方面的问题,你会明显察觉到它无法给出精准且针对性的回答,因为它缺乏相应的专属信息输入。

![图片[28]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-8a3e17dc31d0cb5453adf1fff5884637.png)

给本地AI投喂私密文档

按照以下步骤给AI投喂个人文档。

![图片[29]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-34875137697e99976852be63c7f3f730.png)

![图片[30]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-a6500717f5155f00f394b2d4a4f55aa6.png)

![图片[31]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-7d77f72fd23264f4a5912a4a88caec9f.png)

![图片[32]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-d6e7bad52b0009c48a9e66ee362edfdd.png)

![图片[33]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-a4eaf3bfc46627e2c426e7d00a8f8966.png)

根据上传文档的内容进行提问

将个人文档、商务报告、学术论文等各类文档上传后,在对话框输入与之相关的清晰问题,如 “《三体全集》多少钱”。点击发送,DeepSeek 会快速解析文档,给出精准回答。

![图片[34]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-212b4e6c20b7a9b8d2edbb28ddbaf5bb.png)

![图片[35]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-8a04e95fd8e115414eeeef61c59b4bd7.png)

![图片[36]-DeepSeek R1本地化部署——企业数据零泄露+Web访问+AnythingLLM 个人知识库搭建-杂货铺](/wp-content/uploads/2025/02/frc-fad863b2e89cce3c3878e66df1f6c3f9.png)

数据迁移

AnythingLLM数据迁移:

1、查看数据存储位置:AnythingLLM 一般会将数据存储在其默认的向量数据库中,可在软件设置的 “向量数据库” 选项中查看具体存储路径。

2、使用数据库工具导出:如果向量数据库是常见的类型,如 LanceDB 等,可以尝试使用相应的数据库管理工具连接到该数据库,然后执行导出操作,将数据导出为 CSV、JSON 等常见格式。

3、查看工作区文档列表:在 AnythingLLM 的工作区中,通常会有已上传文档的列表,可通过点击工作区界面中的相关按钮或菜单选项,查找是否有导出文档的功能,可能会提供将单个或多个文档批量导出的操作。

暂无评论内容